آیا ChatGPT مکالمات خصوصی کاربران را فاش کرده است؟

آیا ChatGPT میتواند دادههای کاربرانش را ذخیره کرده و یا حتی منتشر کند؟ این سوالی است که برای اغلب کاربران اینترنت بهخاطر مقالهای که دیروز در تاریخ 30 ژانویه 2024 منتشر شد، ایجاد شده است. در این مقاله نسبتا معتبر ادعا شده بود که براساس شواهد و مدارک، ChatGPT مکالمات خصوصی کاربران را منتشر میکند. در این مطلب به بررسی جزئیات این ادعا جنجالی و پاسخ شرکت OpenAI خواهیم پرداخت.

در ابتدا به بررسی جزئیات این خبر که توسط وبسایت ArsTechnica منتشر شده است، میپردازیم و سپس بیانیهای که OpenAI در این رابطه منتشر کرده است را تشریح میکنیم.

طبق گفته سایت ArsTechnica، کاربری در پروفایل ChatGPT خود، از دیدن چتها و سابقه مکالماتی که متعلق به خودش نبوده است، متعجب میشود و اقدام به گرفتن اسکرینشات از این اطلاعات میکند.

چیس وایتساید، یکی از کاربران ChatGPT است که به گفته خودش، اخیرا نیز اقدام به تعویض گذرواژه حساب خودش کرده است. پسورد انتخابی او نیز ترکیبی از 9 کاراکتر بزرگ و کوچک و همچنین اعداد و علائم بوده است.

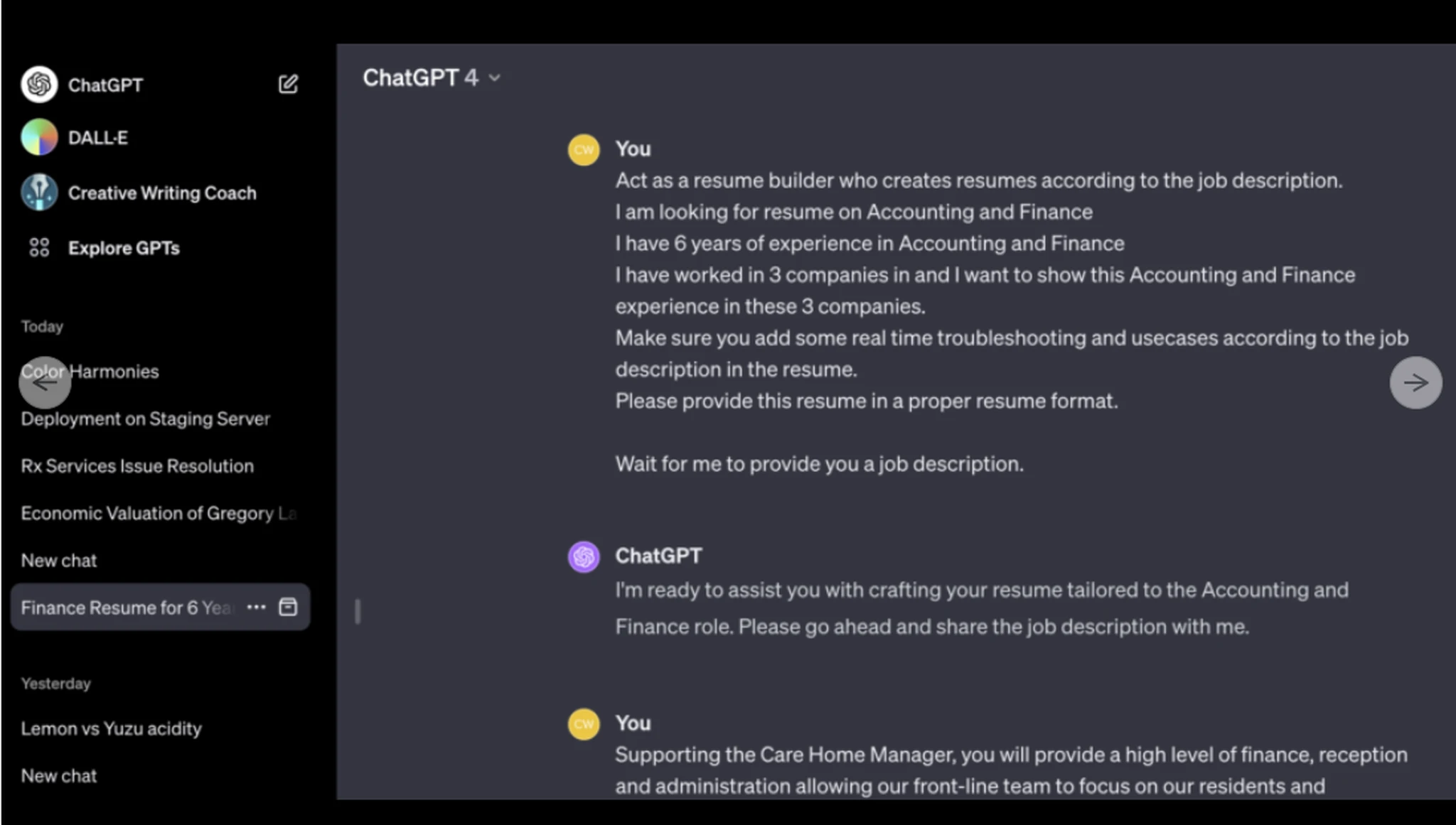

چیس وایتساید میگوید که در صبح روز دوشنبه 29 ژانویه 2024 بود که بهدنبال پرسیدن یک سوال (کمک به یافتن نامهای هوشمندانه برای رنگها در یک پالت) از ChatGPT، متوجه ظاهر شدن اطلاعات عجیبی در سابقه چتهای خود میشود. این کاربر پس از باز کردن این سوابق جستوجو، متوجه میشود که این گفتوگو مربوط به کاربران دیگری است که تاریخچه چتهای این کاربران هم، متفاوت با دیگری است و مطمئنا به یک کاربر تعلق ندارد.

چیس وایتساید در ایمیلی نوشت: یکی از کاربران، کارمند یک داروخانه داروهای تجویزی بوده است که از ChatGPT، برای رفع یک مشکل در پروفایل کاربری خودش در نرمافزار داروخانه استفاده کرده است. اطلاعاتی که ChatGPT، از این چت بهعنوان تاریخچه ذخیره کرده بود، فراتر از انتظار هر کاربر اینترنت است؛ بهطوریکه حتی نام کاربری فرد، رمز عبور، اطلاعات کامل داروخانه که در نرمافزار قرار داده شده بود و حتی برخی نسخههای مراجعهکنندگان در این تاریخچه وجود داشت. این تاریخچه حتی زمان ورود و خروج کاربر و فعالیت آن در پروفایل خودش را نیز ثبت کرده است.

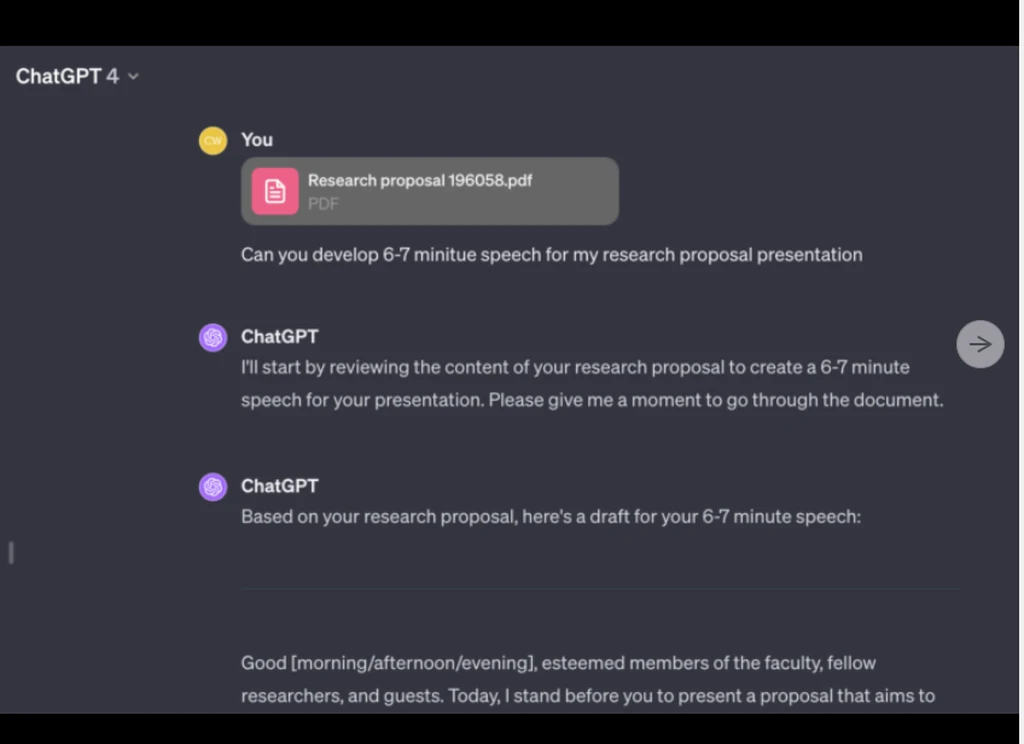

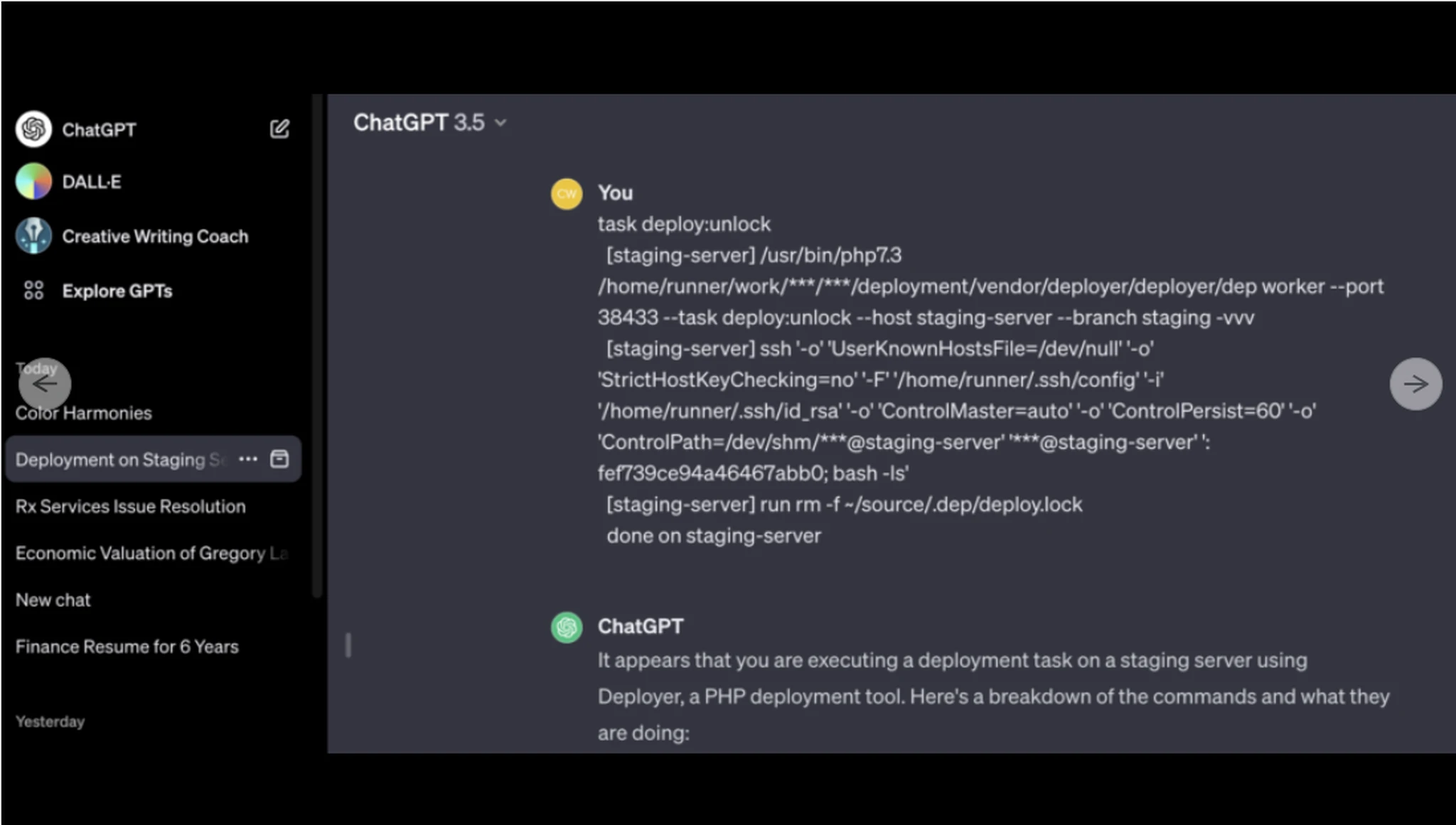

مورد دیگر، مربوط به کاربر دیگری است که از ChatGPT برای نگارش یک پروپوزال تحقیقاتی منتشر نشده و یک اسکریپت که با استفاده از زبان برنامهنویسی PHP بود، راهنمایی گرفته است. فایل تحقیقاتی و اطلاعات دیگری از این کاربر، مواردی هستند که در تاریخچه چت این فرد ذخیره شدهاند.

همچنین مارس گذشته، OpenAI سازنده ChatGPT، چت ربات هوش مصنوعی را پس از یک باگ که باعث شد سایت عناوین سابقه چت یک کاربر فعال را به کاربران غیر مرتبط نشان دهد، آفلاین کرد.

در بخش دوم این مطلب به بررسی بیانه و پاسخ OpenAI به این اتفاق میپردازیم.

OpenAI بیانه خود را اینگونه شروع میکند: مقاله ArsTechnica، قبل از اینکه تیمهای کلاهبرداری و امنیتی ما بتوانند تحقیقات خود را به پایان برسانند، منتشر شد و گزارش آنها متاسفانه نادرست است. بر اساس یافتههای ما، اعتبار ورود به حساب کاربران در معرض خطر قرار گرفته بود و یک کاربر ناشناس از این حساب استفاده کرده است.

نظر این کمپانی در بخش اول آن، متناسب با مقاله منتشر شده است و اذعان میکند که اطلاعات کاربران در معرض خطر قرار گرفته بود. اما در ادامه این بیانه ادعا میکند که در سابقه چتها، اطلاعاتی از کاربران وجود نداشته است و سوابق، نمیتوانسته به کاربران دیگر ظاهر شود. همچنین OpenAI باور دارد که خود کاربر نیز اعتقادی به نفوذ از طرف افراد ناشناس ندارد. وبسایت ArsTechnica نیز معتقد است که سایت ChatGPT هیچگونه حفاظتی مانند 2FA یا توانایی بررسی و ردیابی ورودهای اخیر را ندارد که این حفاظت ها در حال حاضر، در اکثر پلتفرمها در سراسر وب بهنوعی استاندارد تبدیل شدهاند.

توضیح OpenAI احتمالاً به این معنی است که سوء ظن اصلی درباره افشای تاریخچه چت ChatGPT به کاربران غیر مرتبط اشتباه است. OpenAI به ArsTechnica اشاره کرده که این شرکت در حال بررسی این گزارش است.

ChatGPT به بخش مهمی از گردش کار ما تبدیل شده است، و اغلب جایگزین جستجوی Google برای بسیاری از سؤالات می شود. بسیاری از ما از آن برای پرس و جوهای ساده تر استفاده می کنیم، اما با کمک افزونههای ChatGPT، می توانید از هوش مصنوعی برای کارهای پیچیدهتر استفاده کنید. اما توصیه میکنیم مراقب باشید که برای چه چیزی از ChatGPT استفاده می کنید و چه دادههایی را با آن به اشتراک می گذارید.

در همین راستا، شرکتهای بزرگی مانند اپل، دسترسی کارمندانش را به ChatGPT محدود کرده است تا اطلاعات این شرکت، از طریق این چتبات در معرض خطر قرار نگیرند.